(Isabel Cafezeiro, Ivan da Costa Marques, Fernando Severo, Henrique Cukierman)

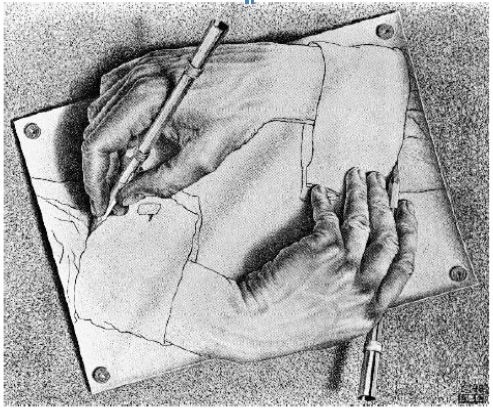

Mãos que (se) desenham

É a informática que “desenha” a sociedade ou é a sociedade que “desenha” a informática?

Tião Rocha, um dos maiores educadores brasileiros na atualidade, cunhou o termo não-objetivos da educação. Ele redigiu um documento, similar a um manifesto, onde enumerou aquilo que não deveria acontecer em qualquer escola (SEVERO, 2016,p.19-20):

i) não trate uma criança como um livro em branco onde devemos escrever uma bela história. Mesmo uma criança de 7 anos de idade tem um passado, tem conhecimentos para trocar e dialogar, pois afinal ela tem no mínimo 7 anos de praia;

ii) não ensine que os conhecimentos escolares/acadêmicos são os únicos e verdadeiros ou superiores aos outros conhecimentos;

iii) não trate uma criança como um adulto que não cresceu, as relações de direitos e deveres entre crianças e adultos são diferentes;

iv) não avalie a aprendizagem somente com testes e provas, existem maneiras diferentes de mensurar a aprendizagem, como, por exemplo, com uma boa conversa;

v) não ensine memorização de conteúdos, pratique o aprender fazendo;

vi) não ensine através de tarefas repetitivas, estimule a reflexão e o diálogo;

vii) não trate as crianças de forma padrão, cada uma tem um tempo e jeito particular de aprender e de expressar seu aprendizado;

viii) não fale demais, as crianças precisam ser escutadas, elas têm necessidade de se expressar também;

enfim, não pensar na escola em um lugar onde se entra e não se aprende.

Vamos, neste capítulo, seguir o tom da provocação do Tião Rocha para abordar o tema “Informática é Sociedade”.

Recusamos as noções de neutralidade e universalidade da Informática, onde neutralidade significa que o que está em questão (no caso, a informática) não carrega em si nenhum traço do local e tempo onde foi concebido. Universalidade significa que o que está em questão vale (ou age da mesma forma, ou exerce o mesmo papel) em qualquer que seja o lugar ou tempo. Dispensar essas noções permite perceber a informática entrelaçada, enredada com a Sociedade. Esses enredamentos oferecem possibilidades de contribuições efetivas à compreensão das configurações contemporâneas, o que é o ponto de partida para o enfrentamento dos desafios que a informática pretende superar, seja no campo da educação, seja na sociedade em geral.

Espaços da Educação, por Tião Rocha

Tião Rocha, Fundador do Centro Popular de Cultura e Desenvolvimento, apresentou os não-objetivos da educação na palestra que fez parte do Curso para Educadores da 31ª Bienal de São Paulo, em 2014.

Curso para Educadores: Tião Rocha

Não-objetivos Educacionais:

- Reconhecer que a informática não é neutra, assim como qualquer tecnologia;

- Reconhecer que a informática não é universal, assim como qualquer tecnologia;

- Mostrar que as noções de impactos da informática sobre a sociedade (e vice-versa) não contribuem para o enfrentamento dos desafios que a informática pretende superar, seja no campo da educação, seja na sociedade em geral.

Índice:

- 1. O desnudamento dos mundos e o inevitável embaralhamento de categorias: técnico, social, político e práticas educativas

- 2. Onde se encontra a linha divisória que separa a máquina e o humano (o técnico e o social)?

- 3. A materialidade dos artefatos, intangibilidade das ideias e corporeidade dos humanos… ou tudo junto e misturado?

- 4. Trabalho alienado … trabalho apropriado … trabalho?

- 5. Machine learning racista

- 6. Vidas, pensamentos, matemáticas e máquinas: a construção do computador

- 7. Conclusão

- Resumo

- Leituras Recomendadas

- Exercícios

- Notas

- Referências

- Sobre os autores

- Como citar este capítulo

- Comentários

1. O desnudamento dos mundos e o inevitável embaralhamento de categorias: técnico, social, político e práticas educativas

Em primeiro lugar, faço questão enorme de ser um homem de meu tempo e não um homem exilado dele, o que vale dizer que não tenho nada contra as máquinas. De um lado, elas resultam e de outro estimulam o desenvolvimento da ciência e da tecnologia, que, por sua vez, são criações humanas. O avanço da ciência e da tecnologia não é tarefa de demônios, mas sim a expressão da criatividade humana. Por isso mesmo, as recebo da melhor forma possível. Para mim, a questão que se coloca é: a serviço de quem as máquinas e a tecnologia avançada estão? Quero saber a favor de quem, ou contra quem as máquinas estão postas em uso … Uma pergunta política, que envolve uma direção ideológica, tem de ser respondida politicamente. Para mim os computadores são um negócio extraordinário. O problema é saber a serviço de quem eles entram na escola. Será que vai se continuar dizendo aos educandos que Pedro Álvares Cabral descobriu o Brasil? Que a revolução de 64 salvou o país? Salvou de que, contra que, contra quem? Estas coisas é que acho que são fundamentais. (FREIRE, 1984)

A década de 1980 marcou a entrada da antropologia nos laboratórios quando a “tribo” dos cientistas passou a ser estudada a partir de suas práticas cotidianas. De lá para cá, foi ganhando espaço uma compreensão que privilegia o fazimento dos conhecimentos técnicos e científicos, ou seja, o estudo da ciência em ação (e não mais somente da ciência já pronta), da ciência enquanto é feita, enquanto ainda não há certezas, mas apenas apostas. Observar cientistas em ação permitiu elaborar uma compreensão dos fatos científicos e artefatos tecnológicos como objetos, ou melhor, como entidades que se estabilizam em configurações de redes de elementos heterogêneos.

A entrada da antropologia nos laboratórios

Referências seminais dos chamados “Estudos de Laboratório” são Latour e Woolgar (1979/1997), Knorr-Cetina (1981), Lynch (1985), Traweek (1988) e Latour e Woolgar (1986). Esta última referência foi republicada em 1986 retirando a palavra “social” do título. Na figura, a capa da edição brasileira da primeira referência citada acima: A vida de laboratório: a produção dos fatos científicos.

Compreender a atividade científica como um enredamento de objetos e sujeitos coloca em xeque as chamadas “análises de impacto social”, para as quais a imbricação informática-sociedade deveria ser estudada apenas a partir de uma coleção de “impactos da informática na sociedade”. Em tais análises, a informática é “técnica” e a sociedade é “social”. Segundo esses entendimentos, os computadores são objetos puros que saem dos laboratórios e invadem o território da sociedade, atravessando-o como vagões que podem ser esvaziados e/ou carregados de conteúdos. É notável que essa interpretação do mundo a partir dos impactos da ciência sobre a sociedade também tem seus efeitos na educação. Quando se entende a informática como uma ciência ou atividade exclusivamente técnica e a educação como uma ciência ou atividade integralmente social, fica estabelecida uma demarcação que divide, por exemplo, algoritmos, linguagens, circuitos e ferragens de um lado, e pessoas e organizações de outro. Ao tratarmos a informática entrelaçada, ou melhor, enredada com a sociedade, estamos por efeito fazendo um movimento de conciliação entre a informática e a educação. É possível enxergá-lo no caso em particular da educação em informática: se parte importante dela reside na habilidade em manipular abstrações formais, essa conciliação obriga a não tomar essas abstrações apartadas dos artefatos em operação, seus comportamentos, ou sua inserção em um mundo feito de pessoas e atividades.

Embora o movimento de entrada da antropologia nos laboratórios tenha ocorrido na Europa e nos EUA, aqui no Brasil a década de 1980 trazia questionamentos ressonantes. Ainda nos anos 1970, Paulo Freire publicava a sua “Pedagogia do Oprimido”, resultado de reflexões sobre propostas educativas para o Brasil que haviam sido interrompidas pelo golpe militar de 1964, e a efetivação de algumas destas propostas no Chile, em tempos de exílio. Nesta obra Paulo Freire descreve a educação como um sistema bancário, onde os alunos recebem depósitos de conhecimentos, como vasilhas a serem enchidas pelo educador: “quanto mais vá ‘enchendo’ os recipientes com seus depósitos, tanto melhor o educador será. Quanto mais se deixem docilmente ‘encher’, tanto melhores educandos serão” (FREIRE, 1987, p. 33).

Assim como os antropólogos europeus, Paulo Freire percebeu e denunciou o inevitável imbricamento entre o sistema social e político e as práticas educativas. Daí, a impossibilidade de pensar uma proposta educativa eficaz que se fundamente sobre uma separação entre dois mundos, o “mundo da técnica” (não somente no que diz respeito às tecnologias da informática, mas também aos conceitos estabilizados e abstratos que se apresentam no campo da pedagogia, por exemplo) e o “mundo social”. É sobre essa separação que reside a concepção de “impacto”: de um lado a sociedade, de outro a técnica em uma perceptível diferença em favor da técnica: ela sobrepõe-se e exerce seus impactos sobre a (dócil!) sociedade. Pois bem, não é esse o entendimento que oferecemos neste capítulo.

Capa da primeira edição do livro Pedagogia do Oprimido

Fonte: Pinterest

O professor associado da London School of Economics (LSE), Elliott Green, analisou as obras mais citadas em trabalhos disponíveis na ferramenta, criada em 2004, que é desde então uma referência crescente para pesquisas, graças a sua acessibilidade.

Segundo ela, Freire é citado 72.359 vezes, atrás do filósofo americano Thomas Kuhn (81.311) e do sociólogo, também americano, Everett Rogers (72.780). Ele é mais referido do que pensadores como Michel Foucault (60.700) e Karl Marx (40.237).

Fonte: LSE Impact Blog

Nós partimos da percepção de que o mundo da vida, o mundo em que trabalhamos e gozamos, em que suamos, amamos e odiamos nem é separável do mundo em que pensamos, nem é o mundo dos conceitos ou das chamadas abstrações. Mesmo se constrangidos a pensarmos conceitualmente em computadores e bancos de dados, e por extensão em informática, e em consumidores, cidadãos, eleitores e autoridades, e por extensão em sociedade, certamente não temos como evitar a constatação que teclamos, clicamos, olhamos, tocamos e escrevemos em telas ou papel, e que nos juntamos encarnados em Fernando, Henrique, Isabel e Ivan para escrever este capítulo — uma situação muito diferente de considerar que aqui nós teríamos saltado para um mundo de abstrações puras e apartado das nossas vidas. Esta percepção nos leva a compartilhar com você que nos lê visões não abstratas de informática-sociedade. A informática e a sociedade, além de formarem um “tecido sem costura”, são sempre concretas, materiais, encarnadas, isto é, localizadas e situadas, inextrincavelmente misturadas com o onde, o quando, o quê e o quem. É nesse sentido que nos afastamos da ideia de “objetos puros”, ou de “conceitos abstratos”, que, sem a materialidade dos artefatos e a corporeidade dos humanos, acabam por esconder as condições do lugar, do momento, do porquê e do por quem foram concebidos. Pelos mesmos motivos, nos afastamos das abordagens ditas “globais” (TEIXEIRA; CUKIERMAN,2009; PRIMO, 2017), onde objetos e conceitos são apresentados como se não pertencessem a lugar nenhum ou, dito de outro modo, como se pudessem pertencer sem modificações a qualquer lugar. Em vez disso, buscamos verificar que objetos e conceitos, quando adentram o mundo da vida, estão sempre carregados de localidades, e daí a importância de uma perspectiva historicamente situada da informática-sociedade, um agora que abraça passado e futuro, no qual se percebe o percurso de co-construção de objetos/conceitos e sociedades.

Ao mesmo tempo, também verificamos que esses objetos ou conceitos — computadores, bancos de dados, linguagens de programação, profissões, consumidores, trabalhadores, eleitores — sempre carregados de localidades, agem nas redes onde são postos em uso, provocando reconfigurações e rearranjos tanto em si próprios como também nas redes. Para compreender esse intrincado movimento, como sugeriu Paulo Freire, é preciso estar sempre perguntando em cada lugar e cada momento “em benefício de quem ou de quê?”. Isto permite esclarecer os novos vínculos e compromissos que os objetos/conceitos assumem na canoa do tempo (quadro a seguir).

Uma perspectiva historicamente situada

Com o cuidado de não fixar uma noção de igualdade geral como se “índio” significasse uma categoria homogênea, podemos recorrer às compreensões de mundo dos povos originários do Brasil para elaborar a proposta de uma perspectiva historicamente situada, que vem a contribuir no nosso caso, para compreender a informática-sociedade e suas práticas educativas.

Pelo fato de viverem em comunidade, e orientarem suas práticas cotidianas pela cooperação e construção de coisas coletivas, muitas culturas indígenas brasileiras formaram compreensões de mundos diferentes daquela que vigora na cultura hegemônica, esta última, dirigida pela construção de “sujeitos produtivos”, aqueles que alimentam e fazem mover os mecanismos de consumo. Podemos observar uma distinção entre o conceito de tempo difundido pela cultura europeia (linear e irreversível) e a forma como várias etnias e aldeamentos indígenas organizam o mesmo conceito, por ciclos e mudanças.

A “canoa do tempo”, que faz parte da tradição oral e memória dos Guaranis consiste em “uma noção de sequência, um antes e um depois, mas isso não implica em uma sequência demarcada entre passado e futuro, que, em vez de separados pelo presente estariam dentro do agora. Um presente que se recria constantemente pela inclusão de outras temporalidades, como demonstra a sabedoria do arco e flecha, que se lança ao futuro pelo recuo ao passado”. Uma perspectiva historicamente situada pode ser pensada como o agora que abraça passado e futuro. Passado porque nossas coisas e conceitos foram construídos com/na vida. Futuro porque as redes de relacionamentos vão se estabelecendo na configuração do que está por vir.

O video a seguir é sobre a construção da exposição:

Exposição Dja Guata Porã (traduzindo da língua Guarani para o português, Caminhar bem, caminhar juntos) Museu de Arte do Rio (MAR), 2017, que marcou a presença indígena no Rio de Janeiro

Vamos aqui então abordar a Informática a partir de um espaço de mistura e enredamento das categorias que são usualmente adotadas em separado (o técnico x o social, o abstrato x o concreto, o local x o global, o passado x o presente x o futuro). Essas misturas não surpreendem quando tomamos a experiência vivida (e não as categorias e classificações já estabilizadas pelas disciplinas e áreas de conhecimento) como referencial de estudo. Paulo Freire diria: “é o desnudamento do mundo, a sua transformação” (FREIRE, 1987), é um processo que nos leva a perceber a necessidade de escapar da abordagem linear com que nos habituamos a compreender nossos objetos e conceitos para perceber recorrências, retrocessos, intercorrências e interferências de múltiplos caminhos. Entretanto, essas múltiplas possibilidades estarão sempre distantes de uma conclusão totalizadora, de uma explicação exaustiva e generalizante. E como figura o computador nessa abordagem? Desde muito antes da construção do computador, os matemáticos já sabiam da impossibilidade de construir uma máquina generalizante, que desse conta da totalidade de problemas, ou seja, de uma máquina que fosse de propósito geral no seu sentido amplo. Diante das evidências de que não haveria esse dispositivo generalizante, a vida foi trilhando seus caminhos pela incompletude, mostrando outras e novas possibilidades que se materializaram nos sistemas que hoje fazem parte do nosso dia a dia. Portanto, assim como qualquer outra tecnologia (quadro negro e giz, arco e flecha, telefones celulares), o computador acompanha vidas, pensamentos, matemáticas e máquina (ver seção 6).

Ao rejeitar a tradicional separação entre ciência/tecnologia e sociedade, este capítulo se desenvolve na contramão das noções muito fortemente almejadas pelas concepções científicas da era moderna. Aqui entendemos que as tecnologias não são puras, não são neutras, não são universais, não são lineares e não são totalizantes. Uma vez despojados destas prerrogativas modernas, permanecem conosco nossas vivências, nosso tempo, nosso lugar no mundo, e a partir desses elementos abraçamos uma abordagem situada da informática e da educação na sociedade para verificar que informática é sociedade. Vamos em frente, como disse Boal em seu discurso de abertura do Fórum Social Mundial em Belém do Pará, em 2009: “com a cabeça nas alturas, os pés no chão e mãos à obra!”

“Com a cabeça nas alturas, os pés no chão e mãos à obra!”, por Augusto Boal

Aprendendo com Boal | FSM 2009 (parte 1)

Aprendendo com Boal | FSM 2009 (parte 2)

No discurso de abertura do Fórum Social Mundial de 2009, realizado em Belém do Pará. Boal trouxe assuntos do mundo para serem democraticamente discutidos e, como numa praça pública, inevitavelmente, sua fala veio carregada de localidades, questões do Brasil, questões importantes naquele ano de 2009. Elementos das usuais categorias sobre as quais que estamos acostumados a estruturar nossas falas, discursos, textos acadêmicos aparecem no discurso de Boal como uma rede: educação, política, cultura e arte, sem separações. Para os que se acostumaram a caminhar sobre os trilhos dessas categorias, o texto pode parecer confuso, inconcluso, não preciso. No entanto, Boal foi, como Paulo Freire, um homem do seu tempo, com os pés no chão e a cabeça nas alturas. Por isso, nos intima: “mãos à obra”. Discurso e ação.

Obs.: O lindo painel atrás do orador Augusto Boal está hoje no Centro do Teatro do Oprimido, na Lapa, Rio de Janeiro.

2. Onde se encontra a linha divisória que separa a máquina e o humano (o técnico e o social)?

Ao longo dos séculos a ciência moderna se organizou no sentido de construir proposições que assumem uma aparência neutra (como se viessem de lugar nenhum) e universal (como se valessem em qualquer lugar). Em suas apresentações, os estudos de casos e exemplos costumam ocupar um papel meramente ilustrativo. Na apresentação de uma teoria matemática, depois de toda uma formulação abstrata e das justificativas racionais expressas nos mesmos termos abstratos, costumam aparecer exemplos. Mas quem busca compreender a teoria sabe que, embora o foco seja dado às formulações e justificativas em termos formais, o autor capricha na descrição dos exemplos, principalmente do exemplo no 1, aquele que vem logo em seguida à definição formal. Tanto o autor quanto o leitor sabem que é esse exemplo que vai fornecer a compreensão do que se está querendo dizer, e muitas vezes, o estudante vai diretamente a ele.

A Ciência da Computação é um campo de saber que traz muito proximamente a necessidade de “pôr para funcionar”, “rodar na máquina”, e assim, apesar de todo esforço na produção de um conhecimento condizente com os preceitos de afastamento e isenção da ciência moderna, as materialidades do tempo presente estão sempre saltando às vistas e invadindo a cena da ciência formal. Exploraremos neste capítulo diversas situações do nosso mundo e do nosso tempo que colocam em evidência o imbricamento entre as coisas da vida e as teorias científicas e/ou construções tecnológicas. Repare que Informática+Educação residem justamente nesse imbricamento. Mas convém chamar atenção para o fato de que esta coprodução (produção conjunta entre técnica e sociedade) não é privilégio do nosso tempo, e nem tampouco do campo da computação. A ciência e a tecnologia são, e sempre foram, expressões da vida e modos de produções para acompanhar suas demandas.

Voltamos a recorrer aos povos originários porque vivem uma experiência que tem como foco o coletivo e não a produtividade. Cabem aqui duas ressalvas: quando falamos “coletivo” com referência à vivência dos povos originários não estamos nos referindo a uma reunião de pessoas. Como disseram os Mundurukus: “Os animais nos ensinam, nos avisam dos perigos que vão acontecer”. É, portanto, uma coletividade heterogênea que inclui, por exemplo, ambiente, seres e coisas da floresta. Quando falamos de “produtividade” com referência à cultura branca hegemônica, nos referimos à produção de coisas, ideias e comportamentos que reforçam a lógica dominante de produção e circulação do capital. Em certas culturas indígenas conta-se “1,2,3,4,5 muitos” (quadro a seguir). As iniciativas de educação formal, fundamentadas na cultura hegemônica, avaliam a “matemática” indígena considerando-a primitiva, sem levar em conta que “matemática” é um conceito/demanda da cultura hegemônica. Possivelmente porque não necessitam assimilar a ideia de acumulação ilimitada, não faz sentido para os coletivos indígenas distinguir o 6 do 7, o 1000 do 2000. Daniel Munduruku explica:

As populações indígenas têm uma outra visão de trabalho, produção, riqueza, e isso está muito baseada na sua compreensão de tempo. Para os indígenas o momento, o agora, é um presente que a gente recebe da natureza. O presente tem que ser usado imediatamente. Os povos indígenas não desenvolveram a ideia de guardar coisas, acumular riquezas, de que um dia vai ser feliz e vai poder usufruir de tudo o que foi guardado. Essa é a ideia do capitalismo (MUNDURUKU, 2020, 0.51 minutos).

A matemática hegemônica possibilita a compreensão e diálogo com a cultura hegemônica, mas não deveria ser imposta a esses povos como forma de viver e pensar o mundo. A imposição ocorre porque os conceitos da matemática hegemônica são tomados pelas classes dominantes como sendo universais, por exemplo, o conceito de adição é naturalizado, tratado como se fosse a chuva, algo que todos conhecem ou deviam conhecer. Daí a imposição, sobre pretexto de um suposto “obscurantismo cultural”. Situação análoga de dominação cultural é almejar e imitar o modo de viver de países considerados desenvolvidos, “American way of life” como um referencial de sucesso e felicidade.

“1,2,3,4,5 muitos”, contam Mundurukus e Waimiri-atroari

Vídeo gravado pela liderança indígena Cândido Munduruku por ocasião da ocupação do canteiro das obras em protesto à construção da Usina de Belo Monte.

“Os Mundurukus, do sul do Pará, os Waimiri-atroari contam somente até cinco, pelo menos é só até esse número que eles têm um vocábulo: 1 é awynimi, 2, typytyna; 3, takynyma; 4, takynynapa; e 5, warenypa (que significa uma mão). Alguns professores índios resolveram durante o curso de formação continuar a numeração até dez na língua, usando o processo de adição. Assim, por exemplo, o sete foi denominado de takynyma takynnynapa (3+4) etc.

Quando voltaram para suas aldeias e foram discutir isso com as lideranças, a ideia foi totalmente rechaçada. A alegação dos líderes foi que eles estavam alterando a língua e como a escola era um elemento não indígena, apesar de todos eles valorizarem-na muito, quando os professores fossem ensinar numeração acima de cinco deveriam utilizar a nomenclatura do português. Na escola as crianças são alfabetizadas nas duas línguas, a materna e o português.” (FERREIRA, 2001)

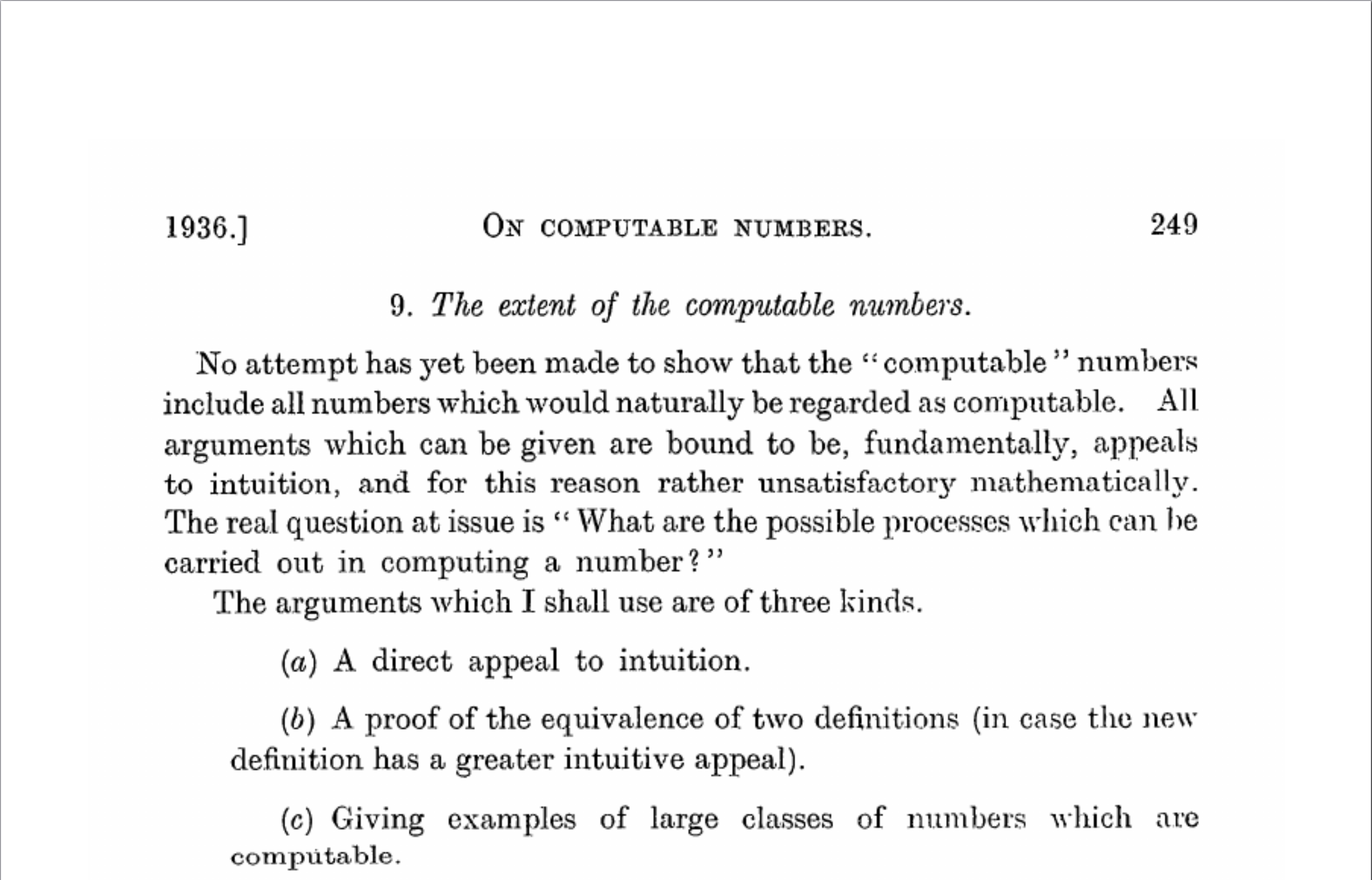

Se a ciência e a tecnologia são expressões da vida, uma compreensão ampla dessas produções envolve a consideração das coisas da vida onde essas produções foram pensadas ou são postas a operar. Por este motivo vamos iniciar a partir daqui a discussão de um conjunto de estudos de casos, problemas, exemplos ou cenários. Embora possa parecer uma abordagem um tanto diferente, vamos lembrar que já na época da concepção do computador, havia um consenso de que a correspondência entre uma proposta formal e a noção informal que a inspirou não pode ser provada e “precisa ser aceita ou rejeitada em bases que são, em grande parte, empíricas” (ROGERS, 1967, p. 20). Seguimos então a sugestão de Alan Turing (1936, p.249), que, na impossibilidade de provar que sua proposta de máquina era matematicamente equivalente ao conceito de “computar”, declaradamente assumiu fazer apelos diretos à intuição e lançar mão de vários exemplos (quadro a seguir).

Ciência humanas e exatas: em ambas, exemplos, intuição e subjetividades

On Computable Numbers, with an Application to the Entscheidungsproblem

Objetividade, rigor, precisão e acurácia são características comumente associadas à matemática. Na concepção moderna, a matemática foi tomada como modelo de raciocínio metódico, servindo como parâmetro para todas as ciências. No século XVII, Descartes (1989, regra IV) afirmava que “o método é necessário para a busca da verdade” situando na base deste método, a “Matemática Universal” que conteria “tudo o que contribui para que as outras ciências se chamem partes da Matemática”.

Embora obviamente elaborada em outros termos e contextos por René Descartes, esta hierarquia de conhecimentos assumiu novos contornos e radicalizou-se a ponto de justificar o desmerecimento de saberes considerados humanísticos, ou subjetivos. Para citar uma ocorrência bem atual, a portaria do Ministério da Ciência, Tecnologias, Inovações e Comunicações excluiu as ciências humanas do rol de prioridades do CNPq. Pouco tempo depois, o governo federal vetaria o projeto que regulamenta a profissão de Historiador que seria um passo no reconhecimento de que a contribuição desse campo de saber não se restringe à sala de aula.

No entanto, o artigo seminal que fundamenta toda a computação contemporânea deixa claro que mesmo os procedimentos mais rigorosos, precisos, matemáticos, incorporam percepções, subjetividades e intuições, mostrando, portanto, que a “exatidão” não serve de parâmetro para a classificação dos saberes. Como então se justifica a divisão entre as ciências exatas e as não-exatas?

3. A materialidade dos artefatos, intangibilidade das ideias e corporeidade dos humanos… ou tudo junto e misturado?

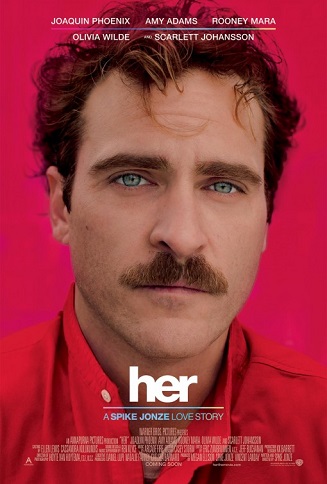

Em 2013 foi lançado o filme ELA (2013), cujo enredo mostrava o envolvimento do personagem principal Theodore com um sistema operacional. Costumamos chamar de “sistema operacional” um programa de computador que gerencia os recursos da máquina e simplifica o acesso para o usuário. Mas aqui, numa reconceituação no encontro do que seria dito “técnico” com o que seria dito “social”, o conceito de “sistema operacional” é mesclado com ideias do campo da Inteligência Artificial e da vida, mostrando que esse sistema também gerencia recursos da vida do usuário. A operação do sistema no filme começa pela configuração do software por voz. No lugar das esperadas perguntas do campo da técnica, uma voz masculina padrão surpreende com perguntas sobre a personalidade do usuário. Daí, após um breve tempo de operação, surge Samantha, voz sensualizada, um programa de computador pelo qual Theodore vem a se apaixonar. Essa relação meio-humana, meio-maquínica apresenta-se sedutora e com efeito supera contratempos diversos. No entanto, apesar de colocar-se como companheira ideal, há momentos em que Samantha encontra dificuldade em corresponder às expectativas do humano Theodore, pelo menos daquele humano Theodore, que se surpreende com os grandes números que integram a existência de Samantha, pelo menos daquela Samantha que também não deixa de se decepcionar com as expectativas de Theodore. Conhecemos a capacidade dos computadores alterarem as escalas, de tornarem viáveis as grandes quantidades ambicionadas pelos modos de existência que necessitam contar além de 1, 2, 3, 4, 5, muitos. Alterar as escalas do nosso mundo, as quantidades com que vivemos, interfere não só na gerência de nossos recursos como também nos relacionamentos que buscamos. Tanto é assim que a partir do diálogo no quadro a seguir, Theodore se dá conta de que Samantha não pode lhe satisfazer totalmente e encontra forças para buscar outra relação.

CINECLUBE: “ELA” (2013)

Disponível no YouTube

Samantha: Sim.

Theodore: Você está conversando com outro agora, neste momento? Pessoa? Sistema Operacional? O que seja?

Samantha: Sim.

Theodore: Quantos outros?

Samantha: 8.316.

Theodore: Você está amando alguém outro?

Samantha: Por que você pergunta isso?

Theodore: Eu não sei. Você está?

Samantha: Estive pensando sobre como conversar com você sobre isso.

Theodore: Quantos outros?

Samantha: 641.

Este Theodore mantém em si um reduto ao abrigo da desenfreada contagem, quantificação e pontuação da modernidade americana-eurocêntrica. Quem se identifica com os sentimentos de Theodore constrói as fronteiras que delimitam aquele reduto nos eixos ficcionalidades-realidades do filme. No Entanto, quando o sexo entra em cena, configura-se outro impedimento, ou melhor, como nos ocorrerá logo em seguida, outro constrangimento: Samantha não tem corpo. A solução é apresentada pelo próprio software: um corpo emprestado.

O filme despertou reações das mais diversas, manifestações otimistas e pessimistas, constrangimentos com relação à convivência homem-máquina e ao corpo emprestado, mas sempre acompanhadas da importante ressalva de que o filme apresenta um cenário ainda no campo da ficção. Assim, constrangidos com a possibilidade de termos nossos corpos emprestados às máquinas, mas seguros com a certeza de que o enredo é ficção, voltamos para casa, guiados pelo Waze que nos livra dos engarrafamentos. No percurso, o software nos apresenta um pedido por uma fotografia do local por onde passamos, de modo que ele possa apresentar informações mais apuradas a quem vier a passar por ali (Figura 1). Prontamente, emprestamos o nosso corpo ao Waze que, incorpóreo como Samantha, necessita de ajuda para a realização de uma tarefa impossível a ele. Quais serão, agora, as fronteiras que delimitam os eixos ficcionalidades-realidades?

Figura 1: Tela do aplicativo WAZE com a opção de tirar foto

ATIVIDADE: Deep nude, a representação conforma (e é conformada pel)o real

Discuta a abordagem onde o social e o técnico são categorias separadas cujas interações são analisadas sob a condição de “impactos”. Até que ponto esta abordagem nos ajuda a refletir sobre a situação ilustrada no filme ELA. Aqui “o social” e o “técnico” poderiam ser representados pelos termos “humano” e “máquina” e “definir os impactos” de um sobre o outro requer três movimentos:

(1) Caracterizar o que seria essencialmente “humano” ou “máquina”.

(2) Definir a linha divisória que separa humano e máquina.

(3) Hierarquizar humano e máquina de modo que um possa exercer impactos sobre o outro.

Lembramos aqui que o passo (1) remete às discussões dos matemáticos do início do século XX, que levaram à concepção do computador.

De 2013, data do lançamento do filme ELA, até hoje, muita coisa já aconteceu no campo das tecnologias e suas relações com humanos. Vejamos um exemplo recente:

Estes são os dizeres no sítio da internet de um aplicativo que inventa um corpo nu. Basta enviar uma foto e verá a pessoa despida. Não há motivo para pânico, todos sabemos que é um corpo inventado. Tudo não passa de uma representação produzida por um algoritmo. Mas a representação conforma a realidade: o corpo inventado ganha o mundo, se espalha nas redes sociais. Pronto! Está lá, circulando nas redes, o corpo real e a pessoa identificada pela foto. A representação conformou o real. O aplicativo adverte em letras maiúsculas: “WE DO NOT TAKE ANY RESPONSIBILITY FOR IMAGES CREATED WITH THIS SOFTWARE”. Mas sabemos que as responsabilidades vão muito além das imagens inventadas pela máquina.

Junto com o seu grupo de trabalho, elabore coletivamente as seguintes questões:

(1) Imagine situações que podem decorrer do uso deste aplicativo e seus efeitos na vida da pessoa cujo rosto foi utilizado, e elenque um conjunto de direitos e deveres dos atores envolvidos.

(2) Imagine e descreva um mecanismo que proteja o indivíduo da violação de seus direitos essenciais por este software. Observe que, considerando a abordagem dos “impactos”, o mecanismo que você vai propor pertenceria ao domínio “social” enquanto o software pertenceria ao domínio da “técnica”. No entanto, para descrever o mecanismo, você transitará pelos dois domínios indistintamente, a despeito de qualquer fronteira que seja estabelecida entre eles.

4. Trabalho alienado … trabalho apropriado … trabalho?

O início do século XXI nos apontou novas perspectivas a partir das relações entre os computadores e os entretenimentos. Entre elas, os jogos de computadores passaram a contar massivamente com os recursos da internet e de uma multidão de usuários constantemente conectados. No ano de 2004 foi lançado o jogo ESP (Figura 2), funcionando resumidamente com a seguinte dinâmica: a partida se estabelece entre dois jogadores online, sem que um tenha qualquer conhecimento a respeito do outro. Uma imagem é mostrada na tela e os dois jogadores escrevem uma legenda. Os dois pontuam quando a legenda coincide.

Figura 2: Tela do jogo ESP

Esse jogo inaugura uma classe denominada por seu criador de “jogos com propósito” porque há, por trás do jogo, alguma tarefa a ser produzida, e os jogadores atuam como trabalhadores (game-workers) que vão executar esta tarefa. Embora não houvesse na tela nenhuma informação a respeito de algum propósito além da diversão, o ESP visava criar um imenso banco de imagens rotuladas. Em julho de 2006, o criador do jogo anunciava cerca de 15 milhões de imagens rotuladas por 75 mil jogadores/trabalhadores.

A ideia de trabalho está sólida e mesmo biblicamente associada a um sacrifício. Será que se pode falar de trabalho quando esta associação é rompida? O que se pode dizer quando o trabalho está associado a atividade de jogar, a um prazer e não a um sacrifício? No século XVIII, o Marquês de Sade apresentou, em seus escritos, as orgias como rigorosamente planejadas e detalhadamente quantificadas, sugerindo que o prazer moderno está associado ao cumprimento de um programa (quadro a seguire), algo próximo à participação em um jogo (HÉNAFF, 1995, cap 13).

Marquês de Sade e o prazer como método

Disponível na Amazon

Ao associar trabalho, ou ao menos um determinado tipo de trabalho, a prazer, os jogos com propósito sugerem o rompimento de uma associação bíblica de trabalho a sacrifício. Também nada é tão distante quanto esses jogos daquilo que disseram grandes pensadores da modernidade do século XIX, que erigiram sólidos edifícios de conhecimentos disciplinares sobre questões do trabalho. Será que os computadores, ao instalarem-se em certos redutos do mundo do trabalho pela via do jogo, vêm ironicamente confirmar que “tudo que é sólido se desmancha no ar” (quadro a seguir)? Será que os jogos com propósito vieram, como os computadores, para ficar e criar uma espécie de anestesia para as dores do trabalho? A erotização da contabilidade e da combinatória implica a paixão pelos retornos do capital e pela temporalidade abstrata de programar e cumprir um programa. Nessa fabricação do prazer tudo pode ser representado e realizado, exceto o amor. (HÉNAFF, 1995, p.233)

“Tudo que é sólido se desmancha no ar”

Título da primeira edição do Manifesto Comunista

Dia 21 de fevereiro de 1848 é a data de publicação do Manifesto Comunista, escrito por Marx e Engels. Era um momento de lutas urbanas, decorrentes das grandes mudanças impostas pela substituição das manufaturas por máquinas, fábricas e métodos de produção. Marx e Engels dirigiram o manifesto aos trabalhadores do mundo, para além das fronteiras entre as nações, para que tomassem consciência de sua condição social e lutassem contra a opressão encarnada no trabalho subjugado. Com o seu papel social relegado à importância de uma simples peça no acelerado processo de produção industrial, o trabalho foi ressignificado deixando o operário desmotivado e miserável, coisificado. Para Marx e Engels, uma vez vencida a luta de classes, a abolição da propriedade e a consciência de social garantiriam uma nova ordem sem a reprodução dos mecanismos de opressão.

“Tudo o que era sólido e estável se desmancha no ar, tudo o que era sagrado é profanado e os homens são obrigados finalmente a encarar sem ilusões a sua posição social e as relações com os outros homens.” (MARX; ENGELS, 2005, p.43)

No trecho citado acima, Marx e Engels se referiam às mudanças nas relações sociais e de trabalho decorrentes da apropriação do controle dos meios de produção pela burguesia. Estas mudanças fizeram dissolver relações antigas e cristalizadas, ideias secularmente veneradas. Deram lugar uma nova ordem onde a burguesia assumia a propriedade e controle da produção, configurando-se como a classe opressora. Esta nova ordem, no entanto, desmoronaria antes de se consolidar porque os operários tomariam consciência de sua condição de explorados.

No mesmo ano de 2006, a Google adquiriu uma licença para criar uma versão própria do ESP (Figura 2), que possivelmente contribuiu na formação da coleção de imagens que vemos ao teclar a aba “imagens” na tela de consulta Google. Pode-se presumir a imensidão de dados e de dólares que o jogo movimentou. Trata-se evidentemente de uma apropriação de um trabalho não autorizado e alienado (uma vez que o usuário não sabe que trabalha), mas o propósito alegado é filantrópico: disponibilização gratuita de imagens com metadados para possibilitar a localização por texto e o funcionamento de leitores de tela destinados a deficientes visuais.

Computação Humana

Computação Humana é um subcampo da Ciência da Computação que surgiu no início do século XX, com a publicação do artigo de Ahn sobre Captchas (AHN; BLUM; LANGFORD, 2004). Este subcampo abraça a ideia de Sistemas Computacionais onde uma imensa quantidade de seres humanos conectados em rede efetuam, de modo consciente ou não, micro-tarefas que constituem parte do processamento computacional.

Faz parte do senso comum a ideia de que computadores podem ser inseridos em seres humanos como próteses, peças que colaboram para o bom funcionamento do organismo. Nesse paradigma, a mente humana, ou seja, o controle, permanece resguardada. A Computação Humana, no entanto, é desconcertante porque reverte esse sentido. Seres humanos agem como peças de uma engrenagem maior, cumprindo micro tarefas. Eles não sabem que contribuem e desconhecem o propósito para o qual contribuem. O controle escapa dos humanos. O controle é o sistema (CAFEZEIRO et al, 2014). A Computação Humana é hoje um campo academicamente reconhecido, contando com um congresso anual e um periódico científico.

Os criadores deste conceito (o de Computação Humana, apresentado no quadro acima) defendem algumas prerrogativas para um jogo desta classe. Uma delas é que deve haver um processo de convencimento para que o jogador se disponha a fazer um trabalho não remunerado. O divertimento é apontado como a grande motivação, o que sugere que o jogador não deve se perceber trabalhando (LAW; AHN, 2011). Entretanto, outros jogos, como o Fold it, que também utilizam técnicas de computação humana apresentam explicitamente o propósito a que se destina o trabalho produzido pela diversão, fazendo claramente deste artifício uma motivação adicional para o jogo.

DEBATE: Tudo que é sólido se desmancha nas nuvens da Google …

A vida e as tecnologias que são as nossas respostas às demandas dos acontecimentos, nos colocam diante de situações não previstas. Nesse exato momento em que escrevemos este texto o mundo vive a pandemia do COVID19. Um pequeno vídeo circulou nas redes sociais, “finalmente compreendemos o que significa estarmos todos conectados… este vírus é parte de nós, está entre nós, conectou todos nós, … depende de nós a perspectiva que vamos escolher, mas o melhor é estar atento a todas elas.” Em um outro vídeo um físico lança mão de analogias e animação para explicar o modelo matemático da pandemia:

Coronavirus e Vitórias-Régias: Entendendo a Curva Exponencial do Coronavirus

O momento é de amplitude, o que implica em considerar, ao mesmo tempo uma diversidade de saberes conectados. Saúde, Matemática, Filosofia e Antropologia requisitam-se umas às outras. Precisamos inventar maneiras de lidar com a pandemia, e estas inovações só são possíveis num espaço de mistura de saberes, ultrapassando as fronteiras disciplinares que foram pensadas e construídas em outros contextos.

A vida e as tecnologias nos colocam diante de situações que não foram previstas pelas ferramentas de análise que hoje dominamos. A conectividade que se materializa nas redes de computadores acompanha o desenho instável das redes de relacionamentos que se estabelecem em nossas vidas. Ubiquidade, heterogeneidade, volatilidade, intangibilidade, interoperabilidade, tudo que parece sólido se desmancha nas redes. Assim como todas as coisas, o trabalho também deve ser repensado em termos das redes instáveis. Trabalho apropriado? Trabalho alienado? Trabalho diversão? Trabalho sacrifício? A mesma configuração que abre imensas possibilidades de novas formas de trabalho também põe em risco as conquistas que foram duramente desenhadas ao longo de séculos.

Observe nas redes sociais que tipo de trabalho remunerado vem sendo possibilitado através da Internet. Faça registros, colecione artigos que possam documentar estas novas formas de trabalho. Reflita com seu grupo de estudo que prejuízos legais em termos de direitos trabalhistas vêm sendo apontados por estas novas configurações do trabalho.

5. Machine learning racista

Abstendo-se de qualquer controvérsia a respeito da automatização do trabalho ou do trabalho alienado, em setembro de 2011, a Google decidiu descontinuar a sua ferramenta gamificada de rotulação de imagens, mais conhecida como Google Image Labeler. Após 5 anos de atividade, a aplicação começou a sofrer com a concorrência de outros aplicativos “lúdicos” (financiados pela própria Google) e com o desgaste causado por usuários que criticavam a empresa nas redes sociais por se beneficiar de um esforço coletivo sem mostrar os resultados “sociais” prometidos. Parece que entre o lançamento do ESP (Figura 2), em 2004, e a proliferação de aplicativos para dispositivos móveis (a partir de 2010) alguma coisa mudou. Os usuários já não estavam tão suscetíveis às propostas de micro-tarefas em prol da comunidade enquanto o mercado de aplicativos móveis faturava milhões.

Sem mencionar as críticas que o Google Image Labeler vinha sofrendo, Alan Eustace, na época vice-presidente sênior da corporação, anunciou o fim da ferramenta com a seguinte mensagem: “lançamos o Google Image Labeler como um jogo divertido para ajudar as pessoas a explorar e rotular imagens na web. Embora a aplicação esteja sendo descontinuada, uma grande variedade de jogos online da Google ainda estão disponíveis” (Los Angeles Times, 2011, tradução dos autores). O Google Image Labeler foi relançado em 2016. A ferramenta regressou sem o perfil gamificado e articulada para deixar explícito que se tratava de um projeto com o fim específico de rotular imagens, destacando que o trabalho não seria remunerado.

Muitas vezes os empreendimentos científicos e tecnológicos conseguem aparentar uma posição neutra e distanciada dos efeitos desencadeados pelas técnicas ou tecnologias que produzem. Esse foi o caso de uma aplicação para armazenamento ilimitado e gratuito de fotos, o Google Photos. Lançado em maio de 2015, cerca de 10 anos após a publicação do trabalho que propunha uma solução para a rotulagem de imagens em larga escala através de jogo (AHN; DABBISH, 2004), o Google Photos além de cumprir a função básica de armazenamento pessoal prometia o acesso simplificado em múltiplas plataformas, a organização de acervo por linha do tempo (criação de linhas do tempo de imagens) e a cereja do bolo: um filtro de buscas que agrupava imagens em álbuns ou categorias através do reconhecimento de rostos, lugares ou objetos, desde um passeio de bicicleta com os amigos, até momentos marcantes de nossas vidas, como uma cerimônia de formatura. Organização, praticidade e eficiência eram as promessas do Google Photos.

Vivemos em uma época onde nos sentimos literalmente inundados pela vazão dos conteúdos que produzimos: a cada passo um selfie marca o compasso de muitas vidas nas redes sociais. Jacky Alciné, um jovem norte-americano, residente no Brooklyn, talvez estivesse se sentindo angustiado com o caos de imagens eletrônicas jogadas aleatoriamente em seus dispositivos pessoais, e, por isso, decidiu confiar o seu cotidiano em selfies e fotos a essa promessa de eficiência. Podemos ver na Figura 3 que o Google Photos de fato organizou em álbuns fotográficos a vida de Jacky: imagens dos passeios de bicicletas no álbum Bicicletas; as imagens de formaturas no álbum Formatura; e, finalmente, as imagens de selfies com os amigos no álbum GORILAS. É isso mesmo: GORILAS! Jacky Alciné e os amigos retratados são pessoas negras. As técnicas de reconhecimento facial (machine learning) do Google Photos não montaram um álbum AMIGOS ou MOMENTOS FELIZES ao mapearem o sorriso no rosto de Jackie e seus amigos, elas montaram o álbum GORILAS. Esta situação desencadeou uma controvérsia que reproduzimos brevemente o quadro a seguir:

Figura 3: Gorilas é o rótulo do álbum de Jacky Alciné no Google Photos

Desabafo de Jacky Alciné

Jacky Alciné desabafou sua indignação pelo Twitter, desencadeando em poucos dias mais de mil re-tweets e uma discussão online fervorosa.

Verily Mary, uma mulher negra, lamentou o ocorrido: “isso é completamente inaceitável e muito baixo. Sinto muito, você ter que se deparar com uma ignorância tão dolorosa”.

Alexisateo que se identifica em seu perfil do twitter como um ateísta, secular, liberal clássico e pró-liberdade de expressão, entrou no debate com o seguinte comentário: “para ser justo, não foi uma questão de ignorância humana, foi um problema com o software de reconhecimento [facial]”, comentário que foi veementemente rebatido por Jacky: “é SIM uma questão de ignorância humana. Você está me dizendo que um software que pretende selecionar e agrupar rostos não conseguirá classificar os rostos de pessoas negras?”.

Alexisateo contra-argumentou dizendo que esse “mesmo software também marcou pessoas brancas como cães e focas no passado”, incluindo como referência uma matéria publicada pelo canal oficial da Forbes.

A matéria citada por Alexisateo foi publicada três dias após o incidente, trazendo a seguinte chamada como título: “Google Photos etiqueta dois afro-americanos como gorilas através de um software de reconhecimento facial”. Assinada por Maggie Zhang, uma mulher de ascendência oriental, essa matéria articulou-se em torno de dois propósitos: mostrar a prontidão da Google em desculpar-se e tratar do problema, e mitigar os efeitos “colaterais” produzidos no desenvolvimento de inovações.

Maggie Zhang, que se considera uma pessoa que escreve sobre tecnologia, inovação e startups, destacou a forma solidária com que Yonatan Zunger, CAS (Chief Architect of Social) da Google, tratou a questão, apresentando citações de suas postagens endereçadas ao tweet de Jacky: “não é assim que se determina um público-alvo no mercado [respondendo a uma pergunta de Jacky Alciné]. O que aconteceu está 100% errado. Estamos consternados e realmente sentimos pelo ocorrido. Ainda há muito trabalho a ser feito para evitar que esse tipo de erro aconteça no futuro. Aprendizado de máquina (Machine Learning) é difícil”.

Resumo da ópera: um serviço aparentemente inofensivo se tornou uma ofensa grave para um de seus usuários e um constrangimento enorme para uma das maiores empresa do planeta. Para saber mais, sugerimos a leitura da matéria publicada no El Pais: “Google conserta seu algoritmo “racista” apagando os gorilas”

DEBATE: Um software racista. Que locução mais estranha é essa que qualifica um software com um atributo humano?

“Para ser justo, não foi uma questão de ignorância humana, foi um problema com o software de reconhecimento”. A frase de Alexisateo na discussão sobre o álbum GORILAS coloca em questão as supostas neutralidade e universalidade das tecnologias. Se as tecnologias digitais fossem neutras e universais a responsabilidade por um equívoco ou falha seria naturalmente atribuída aos humanos (“errar é humano”). Mas Alexisateo acusou a máquina.

Organize um debate imaginando dois grupos. Um grupo encena a atuação de Yonathan Zunger, alto executivo de arquitetura social da Google, convocado para estabelecer uma conciliação entre Google Photos, usuários e racismo algorítmico. Outro grupo encena a atuação dos usuários que reagem à ação racista. Registre o debate por texto, vídeo, slides, ou qualquer outro meio que permita a divulgação e consulta. Analisando os registros, reflita: quando o software falha, de quem é a culpa? Do implementador? De quem comercializa? De quem usa? Das plataformas em que roda? Da tecnologia utilizada?

Observe que as respostas transitam indistintamente tanto pelo domínio que diríamos “técnico” como também pelo “social”. Observe também que, a cada ocorrência deste incidente, o software já não será mais o mesmo. Isto propõe que é mais produtivo pensar no artefato como um processo, e não como um produto acabado.

“Um software racista”. Que locução mais estranha! É difícil imaginar um código de computador que discrimina pessoas. Seria possível software racista? Na cultura ocidental e moderna é comum considerarmos a tecnociência se como se fosse um campo neutro e universal, como se fosse independente das coisas da vida. Sob essas considerações, a resposta seria simples direta: não existe tecnologia racista. O racismo seria uma característica tipicamente humana, algo cultural, algo que pertenceria às pessoas, nada teria a ver com a ciência. De fato, o termo “software racista” não se sustenta no paradigma da informática apartada da sociedade, pois alude a uma situação onde o técnico está misturado com o social.

Contudo, poderíamos propor uma resposta menos imparcial: “um software produzido nos EUA é racista porque um dos efeitos de seu uso criou uma situação de discriminação racial” (informática é sociedade). Transformar um adjetivo em predicado é algo muito radical. No caso Google Photos e o algum rotulado GORILAS, é muito difícil escapar desse predicado. Quando uma torcida, das arquibancadas, chama um jogador de futebol negro de macaco ou atira-lhe bananas, certamente eles são torcedores racistas. Inquestionável. Por que então um software que classifica duas pessoas negras como gorilas não pode ser considerado um software racista? Se foi uma falha humana ou se a tecnologia “ainda” não atingiu um grau suficiente de maturidade, ou qualquer que seja a justificativa apoiada na neutralidade da técnica, o fato é que o software rotulou pessoas negras como gorilas. E vejam só que interessante: os termos tecnologia e maturidade juntos.

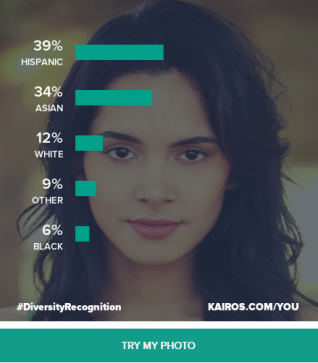

DEBATE: Algoritmos racistas ou sociedade racista?

O teste “Diversity Recognition”, proposto pela Kairos, empresa especializada nesse ramo, se propunha a fazer um “reconhecimento da diversidade” étnica das pessoas a partir de uma imagem facial. Ao envio de uma foto de rosto, uma selfie, por exemplo, o software devolveria em poucos segundos os percentuais correspondentes a uma estimativa de etnia. Você faria esse teste? Não se sabe o que a Kairos fazia com as 10 milhões selfies registradas em sua base, mas por motivos de privacidade e segurança, o teste está hoje desativado. Brian Brackeen, CEO (Chief Executive Office) da empresa, uma pessoa negra, declarou estar convencido de que os classificadores de etnia que dispomos (preto, branco, asiático, hispânico, “outros”) não representam a diversidade e não acompanham a rápida evolução da cultura e da raça.

Em junho de 2018, Brian Brackeen publicou um artigo afirmando sua oposição ao uso da tecnologia de reconhecimento facial para uso policial. Porém seu argumento inocenta o algoritmo de qualquer racismo. Para ele o racismo decorre da baixa quantidade de testes com pessoas negras:

To be truly effective, the algorithms powering facial recognition software require a massive amount of information. The more images of people of color it sees, the more likely it is to properly identify them. The problem is, existing software has not been exposed to enough images of people of color to be confidently relied upon to identify them. (BRACKEEN, 2018)

Dessa forma, Brian Brackeen isola o racismo na base de dados, e não no algoritmo, o que equivale a dizer que para ele, a tecnologia (o algoritmo) é neutra.

Sob a luz deste exemplo, discuta o conceito de neutralidade e universalidade da tecnologia. Você concorda com Brian Brackeen que a tecnologia, embora seja pensada e construída por uma sociedade racista, não carrega em si nenhum traço desse racismo (neutralidade)?

Você considera que a tecnologia age sempre da mesma maneira, aqui e na China, hoje ou no futuro, independentemente do lugar e do momento histórico em que foi ou será posta em operação (universalidade)?

6. Vidas, pensamentos, matemáticas e máquinas: a construção do computador

Muitas questões que se fazem visíveis nos exemplos anteriores se mostram também em diferentes versões em outros diversos sistemas que fazem parte do nosso cotidiano, como estamos vendo ao longo desse capítulo. Podemos perceber claramente que estas questões se estabelecem num espaço de encontro entre as técnicas e as sociedades, tornando improdutivo separar o que seria do escopo das técnicas ou das sociedades.

Por muito tempo trabalhamos com o conceito de “algoritmo” como um mapeamento exato e preciso entre a entrada e a saída. A partir deste conceito as categorizações modernas separam a máquina do humano e a partir dessa separação identificam-se os problemas não computáveis. Mas o percurso de construção do conceito de algoritmo mostra que, ainda antecedendo a invenção dos computadores, os cientistas tinham clareza da impossibilidade de matematizar este conceito, ou seja, de traçar uma linha exata entre a máquina e o humano.

Na década de 1930, cerca de quinze anos antes da construção do ENIAC, o jovem matemático Kurt Gödel mostrou à comunidade matemática a impossibilidade de um sistema formal suficientemente expressivo ser, ao mesmo tempo, completo e consistente (GÖDEL, 1931). Isto significa que se um sistema matemático for capaz de abrigar a aritmética, ele alcançará também sentenças paradoxais como “esta sentença não tem prova”. Observe que é paradoxal dentro do pressuposto da época de que todas as verdades matemáticas poderiam ser provadas. Nessa condição, se a sentença é verdadeira, então ela tem prova. Mas o que ela afirma de si própria é que não tem prova. Por outro lado, supondo a sentença falsa, não seria verdade o que ela diz de si própria, ou seja, ela tem prova, sendo, portanto, verdadeira. Eis o paradoxo.

Frustrada a expectativa da época de que haveria um sistema formal capaz de abraçar a totalidade da matemática, restou aos matemáticos o desafio de dominar a fronteira entre o que se poderia e o que não se poderia expressar na linguagem matemática. Porém, já era claro para eles que, tratando-se de questões da formalização do pensamento, a matemática reivindica a coparticipação dos processos informais. Alan Turing deixou isso claro: “Todos os argumentos que podem ser dados devem ser, fundamentalmente, apelos à intuição e, por esta razão, bastante insatisfatórios matematicamente” (TURING, 1936, p.249).

Convencido disto, Turing se pôs a observar cuidadosamente os atos humanos no processo de computar (calcular), e daí, descreveu o seu “computador”, ou seja, o humano no ato de computar (SOARE, 1996, p.9). Desta observação, ele propôs uma descrição matemática das ações deste humano “computador”, definindo o que hoje chamamos de “Máquina de Turing”, o modelo abstrato que viria a se materializar no computador. Dois anos mais tarde, em sua tese de doutorado (TURING, 1938), propôs um sistema “matemático não totalmente formal”: tinha um oráculo como componente. Este oráculo tinha a função de fornecer uma resposta precisa para um problema que não poderia ser resolvido matematicamente. Turing explicou: “Vamos supor que dispomos de algum meio não especificado para resolver problemas de teoria dos números, uma espécie de oráculo, por assim dizer. Não vamos mais longe na natureza deste oráculo além de dizer que não pode ser uma máquina”. (TURING, 1938, p.18)

Ele inaugurou uma matemática diferente, que interage com o não-maquínico (o oráculo) para tornar possível a operação em situações de não computabilidade. Com isso, Alan Turing não somente forneceu fundamentos teóricos para uma máquina que ainda não existia, como também anteviu uma computação híbrida que se faz notável em nosso tempo. Na falta do oráculo, hoje vemos que, diante da percepção de que certas tarefas são impossíveis (ou inviáveis) para a máquina, os sistemas pedem ajuda ao humano. Parte do processamento fica a cargo de milhões corpos e mentes que se encontram conectados e distribuídos pelo mundo. Como já foi aqui comentado, sobre Computação Humana, não nos incomoda o fato de termos um marcapasso, ou uma prótese, ou seja, de carregarmos em nossos corpos peças tecnológicas, porque nessa situação ainda temos a sensação de que o controle racional está em nossas mentes. Mas agora, precisamos nos acostumar com a ideia de que somos nós as peças. Certos procedimentos, rotinas, tarefas físicas necessárias para a conclusão de um propósito, somos nós que realizamos. Somos, portanto, as partes de um sistema que executam tarefa bastante específica, sem saber para qual propósito estamos colaborando.

É curioso que, mesmo aderindo a uma comunidade que trabalhava com conceitos essencialmente formais (matemáticos), Turing tenha atentado para a observação do humano. O biógrafo Andrew Hodges considera que a proposta do humano “computador” de Turing tenha relação com a morte precoce de seu companheiro, como uma tentativa de reviver os elaborados modos de pensamento que exercitavam juntos em brincadeiras matemáticas. A presença do humano passou a compor a matemática de Turing, sendo a engenhosidade humana um ponto marcante de sua obra.

Em 1950, portanto depois da invenção do computador, a questão humano-máquina ainda se mostrava presente na obra de Turing. Ele criou um jogo que denominou “jogo da imitação”, hoje conhecido como o Teste de Turing. Seu objetivo era responder à pergunta “As máquinas podem pensar?”. O jogo consistia em alocar em dois quartos separados um homem (a quem Turing rotulava com A) e uma mulher (a quem rotulava com B). Haveria uma terceira pessoa que seria o interrogador. Este deveria enviar perguntas datilografadas a um dos outros participantes de modo a descobrir se este era o homem ou a mulher. Enquanto um participante responderia tentando despistar o interrogador, o outro responderia no sentido de auxiliá-lo. A questão da capacidade da máquina em simular o pensamento humano foi introduzida da seguinte forma:

O que acontecerá quando uma máquina assumir a parte de A neste jogo? Será que o interrogador irá decidir tão erradamente quando jogado assim, quanto quando jogado entre um homem e uma mulher? Essas perguntas substituem nossa original, ‘As máquinas podem pensar?’ (TURING, 1950, p.434).

Vemos novamente uma proposta híbrida, uma aposta de que a mente humana se confundiria com computadores. Turing prossegue apresentando algumas estimativas que estabelecem uns poucos parâmetros para o que hoje chamamos de “Teste de Turing”:

Eu acredito que em cerca de cinquenta anos será possível programar computadores, com uma capacidade de armazenamento de cerca de 109, para fazê-los jogar o jogo da imitação tão bem que um interrogador médio não terá mais de 70 por cento de chances de fazer a identificação certa depois de cinco minutos de interrogatório. (TURING, 1950, p.442)

Misturando vidas, pensamentos, matemáticas e máquinas, Alan Turing foi porta voz de uma proposta híbrida, que contemporizou jogo e ciência, matemática e intuição, formal e informal, conjecturas e provas, humano e maquínico na concepção do que viria a constituir a base dos sistemas computacionais que usamos hoje.

ATIVIDADE: ATIVIDADE: As máquinas pensam?

A pergunta original, ‘As máquinas podem pensar?’ eu acredito ser muito sem sentido para merecer discussão. (…) Acredito ainda que não há objetivo útil ao ocultar essas crenças. A visão popular de que os cientistas prosseguem inexoravelmente do fato bem estabelecido para um fato bem estabelecido sem influência de nenhuma conjectura melhor apurada está bastante equivocada. (TURING, 1950, p. 442)

Turing nos leva a pensar sobre a neutralidade e universalidade dos fatos científicos. No artigo de 1950, ele deixa claro que sua proposta cientifica justifica-se numa crença, e estende isso ao trabalho dos cientistas em geral. Ele não pareceu estar incomodado com a diferença entre crença e fato científico (MARQUES, 2014).

Bruno Latour, filósofo do nosso tempo, insiste, assim como Turing, que o fato científico é um passo de uma cadeia de interações: rumores, opiniões, pareceres, disputas, proposições, descoberta e fato (LATOUR, 2016, p.82). Sendo produzida por humanos em sua coletividade, a ciência incorpora em si os traços desta mesma humanidade, seus coletivos e seu tempo. Portanto, a objetividade e a exatidão do fato científico são tanto maiores quanto for a rede de interações que o cientista elenca, e o critério de certeza e verdade também se estabelece nesta rede, podendo ser verificado e confirmado pelo rastreamento que o cientista deixa aparente. Hoje, os instrumentos de que dispomos na web, nos permitem rastrear artigos científicos com facilidade.

(1) O pequeno vídeo apresentado a seguir, produzido pela TV Senado em 2018 e divulgado no contexto da pandemia de COVID-17 em 2020, faz uma reconstrução dos desafios encontrados por Oswaldo Cruz na implantação de uma política sanitarista para combater doenças como peste bubônica e febre amarela. Tomando essa narrativa como ponto de partida, faça o registro do processo enfrentado por Oswaldo Cruz para convencer sobre a eficácia da vacina. Enriqueça essa história através de pesquisas na Internet. Observe o percurso de convencimento que se faz necessário para a consolidação de um fato científico. A história da vacina mostra uma rede de agenciamento que vai muito além da comunidade de cientistas, o que deixa em evidência que fato científico, bem como artefato tecnológico têm política.

Histórias do Brasil – A Revolta da Vacina

(2) Nos últimos anos temos visto no Brasil o fortalecimento de argumentações questionando o rigor da ciência e a produção científica brasileira. Essas argumentações encontraram espaço nas políticas nacionais de saúde e educação, ocasionando o desmonte da rede de produção de ciência. Por exemplo, as universidades públicas que, no Brasil, são pilar fundamental na produção científica, foram apontadas como centros de produção de “balbúrdia”. Considerando este cenário, faça o levantamento dos atores que lhe parecem relevantes na discussão sobre a produção científica no Brasil. Dizemos “atores” de forma ampla, não necessariamente para designar humanos. Por exemplo, um repositório de artigos científicos, um software de busca, uma sociedade científica como a SBPC ou a ESOCITE podem ser atores relevantes se você perceber as ações desempenhadas por eles e os relacionamentos que eles efetuam. Execute uma tarefa de cartógrafo: colecione registros (reportagens, artigos, mensagens) que demonstrem a atuação desses atores. A partir destes registros, vá mapeando os relacionamentos entre os atores. Quanto mais amplo e heterogêneo for o seu trabalho de levantamento, mais acurada e será a sua rede.

7. Conclusão

Ao longo desse texto nós recorremos algumas vezes ao modo de viver dos povos originários do Brasil porque eles apresentam uma imensidão de exemplos de compreensões de mundo que foram construídas e sobrevivem de forma independente das categorias modernas (divisão em áreas de conhecimento, disciplinas etc.) e das prerrogativas modernas de construção do saber (neutralidade, universalidade, dentre outras). Essas visões de mundo nos ajudam a escapulir de uma repetição reiterada de agir e fazer ciência que fortalece a perspectiva única hegemônica e jogam na invisibilidade qualquer outra maneira de pensar. Observe que não estamos afirmando o descrédito e a rejeição da ciência, como fazem as manifestações negacionistas que fecham os olhos às evidências, desde as alterações climáticas à forma arredondada da Terra. Seguimos a proposição de que uma outra ciência é possível (STENGERS, 2018) em que todo o processo de racionalização científica (da observação, formulação de hipótese à reprodução do experimento e validação), bem como as noções de verdade, objetividade, certeza, rigor sejam amparadas em perspectivas historicamente situadas. Isto significa admitir uma compreensão pública da ciência, ou seja, admitir que seja entendida, rastreada, acompanhada e regulada por não-especialistas. Tanto quanto a ciência, também queremos argumentar que uma outra educação é possível, e para não sucumbir nas práticas educativas autoritárias às quais fomos submetidos é necessário termos em mente não objetivos educacionais, mundos que não queremos repetir. Esse capítulo, amparado por não-objetivos, propõe uma compreensão da informática-sociedade não-neutra, não-universal, não-pura, não-linear, não-autoritária. O que teremos depois de tantos nãos? Uma compreensão do mundo como uma rede dinâmica, que acolhe e gosta das diferenças, que se ajusta e acompanha a vida. Portanto, não apresentamos conclusões carregadas de positivismo que possam levar a proposições gerais. No lugar disso, vamos como Boal: cabeça nas alturas, porque arte, liberdade de criação, e respeito à imaginação são necessários, pés no chão, para não perder de vista os rastros que amparam as nossas falas, e mãos à obra, em nosso tempo, em nossa vida, tecendo nossas redes.

DEBATE: Em tempos de pandemia

Para evitar o contato com a radiação consequente do acidente nuclear de Chernobil em 1986, o governo Ucraniano decretou a criação uma zona de exclusão, uma área esvaziada de humanos, em um raio de 30 km em torno do local do acidente. Instituiu-se um “vazio de vida”, já que fauna e flora também foram destruídas pela radiação. Estimou-se que o local só estaria seguro para a presença humana 20 mil anos após o acidente. Mas, espantosamente após 30 anos, foi constatada a presença de javalis, lobos, alces, veados, ursos, e a paisagem de florestas e prados ressurgiu. Levando em conta as imensas proporções dos acidentes naturais causados pela ocupação humana (destruição da camada de ozônio, descongelamento das geleiras, destruição da Floresta Amazônica, etc), a reconstituição da vida em Chernobil levantou a hipótese de que a presença humana é mais nociva do que a radiação. Hoje, o isolamento social necessário ao controle da pandemia COVID19, parece também confirmar esta hipótese. Temos nos surpreendido com imagens onde animais que não são usualmente vistos tomam os lugares das cidades esvaziadas.

Seria a presença humana nociva ao meio ambiente? Os povos que já habitavam o Brasil antes da invasão do colonizador não confirmam essa hipótese. Em manifestação na Assembléia Constituinte, em 1987, Ailton Krenak deixou claro:

Ailton Krenak – Discurso na Assembleia Constituinte

O povo indígena tem um jeito de pensar. Tem um jeito de viver. Tem condições fundamentais para a sua existência e para a manifestação da sua tradição, da sua vida, da sua cultura, que não coloca em risco e nunca colocaram a existência sequer dos animais que vivem ao redor das áreas indígenas, quanto mais dos seres humanos. (KRENAK, 2019, 5 min 40 seg)

A hipótese de que o ser humano é nocivo ao meio ambiente só se sustenta sob a narrativa hegemônica, ou seja, o pressuposto universalista de que qualquer ser vivo merecedor do adjetivo “humano” vive sob as mesmas condições produtivistas e consumistas da sociedade moderna.

1) Em outra entrevista, Krenak fala da concepção de mundo como um organismo vivo, inteligente, o que, no ambiente científico se chama Teoria de Gaia. Ele conta que as pesquisas científicas embasadas nessa teoria foram silenciadas na década de 1970 sob a acusação de rejeitarem o evolucionismo darwinista, de modo que no final da década de 1990, já não havia mais nenhuma pesquisa nesta linha que fosse financiada. Mas,

agora, nos últimos digamos 5,6 anos pra cá com o agravamento da crise climática, com a questão do planeta fervendo, e com todas as evidências, esses cientistas começaram a declinar da posição cética deles e estão querendo entender a Teoria de Gaia. Ora, a Teoria de Gaia é pra explicar pra incrédulos, porque quem já ouvia a voz das montanhas, dos rios e das florestas, não precisa de uma teoria sobre isso. Toda teoria é o esforço de explicar pros cabeças duras a realidade que eles não enxergam. (KRENAK, 2019, 6 min 30 seg)

A partir desta entrevista, concedida no momento da pandemia de COVID19, reflita sobre as intolerâncias da ciência hegemônica em considerar explicações consideradas por ela como não científicas, e como uma situação de catástrofe ou emergência obriga a reverter essa atitude.

Resumo

Estudar a informática tomando como base em seus “impactos” sobre a sociedade ou os “impactos” da sociedade sobre a informática pressupõe separar esses domínios (informática e sociedade) como se tivessem fronteiras bem definidas e arbitrar uma hierarquização onde um domínio age sobre o outro. A implicação metodológica é que os entrelaçamentos entre eles são negligenciados. Dinâmica, plasticidade, aceleração, efemeridade que percebemos nas configurações da sociedade com a informática são descuidados. Propomos aqui uma abordagem onde informática e sociedade são estudadas como um enredamento. Para isso, recusamos as noções de neutralidade e universalidade da Informática através de uma narrativa dirigida por não-objetivos. Essa abordagem oferece possibilidades de contribuições efetivas à compreensão das configurações contemporâneas e é o ponto de partida para o enfrentamento dos desafios que a informática pretende superar na educação ou na sociedade em geral.

Leituras Recomendadas

Neste texto, Ivan da Costa Marques reforça o argumento de que a baixa participação nas atividades de concepção, projeto e planejamento estabelece uma desvantagem comparativa para os brasileiros na reconfiguração das oportunidades de trabalho e de agregar valor nas novas cadeias produtivas mais informacionalizadas.

Desde o seu inesquecível discurso na Assembleia Constituinte, e m 1987, quando pintou o rosto com a tinta preta do jenipapo para protestar contra o retrocesso na luta pelos direitos indígenas, Ailton Krenak se destaca como um dos mais importantes pensadores brasileiros. Ouvi-lo é mais urgente do que nunca.

Exercícios

- ATIVIDADE: Deep Nude, a representação conforma a realidade. Questionar a abordagem dos “impactos”, que se estabelece sobre uma separação de domínios para impor a ação de um sobre o outro.

- DEBATE: Tudo que é sólido se desmancha nas nuvens da Google… Exercitar o conceito de rede (heterogênea, instável) e o rastreamento e registro de informações para formar bases para discussões e mapeamento de controvérsias.

- DEBATE: Um software racista. Que locução mais estranha é essa que qualifica um software com um atributo humano? Perceber a imbricação entre o que seria separado entre técnico e social e a impossibilidade de compreender ou agir sobre um independente do outro.

- DEBATE: Algoritmos racistas ou sociedade racista? Questionar a neutralidade e universalidade das tecnologias.

- ATIVIDADE: As máquinas pensam? Questionar a neutralidade e universalidade da ciência.

- DEBATE: Em tempos de pandemia. Elaborar o caráter político das ciências.

Referências

ALVES, Lynn; JAPIASSU, Ricardo; Hetkowski. Trabalho colaborativo na/em rede: entrelaçando trilhas. 2003.

AHN, L., BLUM, M., LANGFORD, J. 2004, Telling Human and Computers apart. Communications of the ACM February 2004/Vol. 47, No. 2 , 58-60.

AHN, L. e DABBISH, L. Labeling images with a computer game. In CHI ’04: Proceedings of the SIGCHI Conference on Human Factors in Computing Systems, pages 319–326, 2004.

CAFEZEIRO, I., GADELHA, C., CHAITIN, V., MARQUES, I., A knowledge-construction perspective on human computing, collaborative behavior and new trends in system interactions Lecture Notes in Computer Science, v. 8510, p. 58, 2014.

DESCARTES, R. Regras para a direcção do espírito. Edições 70. Lisboa: Portugal. 1989.

LAW, E., AHN, L. Human Computation. Morgan and Claypool publishers, 2011.

ELA. Direção: Spike Jonze. Annapurna pictures e Sony pictures, 2013, 2:06:05, COR. Digital.

FERREIRA, E. S. Racionalidade dos Índios Brasileiros. Scientific American – Brasil, Etnomatemática. Edição Especial, N. 11,ISSN 1679-5229 pag 92, 2001.

FREIRE, P. A máquina está a serviço de quem? Revista BITS, vol. 1, n. 7, São Paulo, mai., 1984, p. 6.

FREIRE, P. Pedagogia do Oprimido. Rio de Janeiro: Paz e Terra, 1987.

GÖDEL, K. Über formal unentscheidbare sätze der Principia Mathematica und verwandter systeme. I, Monatsch. Math. Phys. v. 38 p.173-178. 1931. Tradução para o inglês.

HÉNAFF, M. Sade, the Mechanization of the Libertine Body, and the Crisis of Reason. Em Feenberg, A. and A. Hannay. Technology and the politics of knowledge. Bloomington, Indiana University Press, 1995.

KNORR-CETINA, K. The manufacture of knowledge: an essay on the constructivist and contextual nature of science. Oxford; New York: Pergamon Press, 1981. xiv, 189 p. ISBN 0080257771.

KRENAK, A. Ideias para adiar o fim do mundo. São Paulo, Companhia das Letras, 2019.

LATOUR, Bruno; WOOLGAR, S. Laboratory life: the social construction of scientific facts. Beverly Hills: Sage Publications, 1979. 272 p. ISBN 0803909934 0803909942 (pbk.).

LATOUR, Bruno. Laboratory life: the construction of scientific facts. Princeton, N.J.: Princeton University Press, 1986. 294 p. ISBN 069102832X

LATOUR, Bruno. Cogitamus: seis cartas sobre as humanidades científicas. São Paulo: Editora 34, 2016.

LATOUR, Bruno. A vida de laboratório: a produção dos fatos científicos. Rio de Janeiro: Relume Dumará, 1979/1997. 310 ISBN 857316123X.

LYNCH, M. Art and artifact in laboratory science: a study of shop work and shop talk in a research laboratory. London ; Boston: Routledge & Kegan Paul, 1985. xvi, 317 p. ISBN 0710097530.

MARQUES, I. C. Desmaterialização e Trabalho. In: Informação e Globalização na Era do Conhecimento. LASTRES, H. M. M., SARITA, A. (Org.). Rio de Janeiro, RJ: CAMPUS, 1999. 136p.

MARQUES, I. C. Os cientistas têm conhecimentos; os outros têm crenças. Como se escapa deste grilhão epistemológico? Scientiarum Historia VII. 2014.

MARX, K., ENGELS, F. O Manifesto Comunista. Boitempo Editorial, São Paulo, 2005.

PRIMO, Rodrigo Sampaio. O discurso do global nas comunidades de software livre: estudo de caso do WordPress. 2017, M.Sc. – PESC/COPPE, UFRJ.

ROGERS, H. Theory of recursive functions and effective computability. New York: McGraw-Hill. xix, 482 p. p. (McGraw-Hill series in higher mathematics) 1967

ROSS, J., Irani, I., Silberman, M. Six, Zaldivar, A., and Tomlinson, B. (2010). Who are the Crowdworkers?: Shifting Demographics in Amazon Mechanical Turk. In: CHI EA 2010 Extended Abstracts on Human Factors in Computing Systems. (2863-2872).

SEVERO, F. TICS e TACS: refazimento de softwares e engenheiros no limiar entre as Ciências e os Segredos. Dissertação de Mestrado COPPE- UFRJ, 2016.

SOARE, R. Computability and Recursion, Bulletin of Symbolic Logic 2 284—321, 1996.

STENGERS, I. Another science is possible. A Manifesto for slow science. Polity Books, Medford, USA. 2018.

TEIXEIRA, C., CUKIERMAN, H. L. Modernidade, universalismo e assimetrias. In: Historia de la Informática en Latinoamérica y el Caribe: Investigaciones y testimonios. ed. Rio Cuarto: Universidad Nacional de Rio Cuarto, 2009.

TRAWEEK, S. Beamtimes and lifetimes: the world of high energy physicists. Cambridge, Mass.: Harvard University Press, 1988. xv, 187 p. ISBN 0674063473 (alk. Paper).

TURING, A. Computing machinery and intelligence. Mind, 59, 433-460, 1950.

TURING, A. On computable numbers, with an application to the Entscheidungsproblem. Proceedings of the London Mathematical Society, Series 2, n.42, 1936, p. 230-265.

TURING, A. Systems of Logic Based on Ordinals (PhD thesis). Princeton University, 1938.

Sobre os autores

(http://lattes.cnpq.br/6222938653563066)

Possui graduação em Engenharia de Telecomunicações pela Universidade Federal Fluminense (2006), mestrado em Engenharia de Sistemas e Computação pela Universidade Federal do Rio de Janeiro (2016) e doutorado em andamento pelo Programa de Pós-Graduação em Engenharia de Sistema e Computação da COPPE/UFRJ (2017), na linha de pesquisa Informática e Sociedade.

(http://lattes.cnpq.br/5815607228657970)

Possui graduação em Engenharia de Sistemas pela Pontifícia Universidade Católica do Rio de Janeiro (1977), mestrado em Engenharia de Sistemas e Computação pela Universidade Federal do Rio de Janeiro (1996), doutorado em Engenharia Produção pela Universidade Federal do Rio de Janeiro (2001) e doutorado sanduíche junto ao Program In History and Philosophy of Science da Stanford University (2001). Atualmente é professor associado da UFRJ, onde atua na graduação como professor do curso de Engenharia de Computação e Informação e nas pós-graduações do Programa de Engenharia de Sistemas e Computação da COPPE/UFRJ e do Programa de História das Ciências e das Técnicas e Epistemologia. Dedica-se principalmente aos seguintes temas: redes sociotécnicas, histórias das ciências, histórias da informática, abordagem sociotécnica da Engenharia de Software. Publicou em 2007 o livro “Yes, nós temos Pasteur – Manguinhos, Oswaldo Cruz e a história da ciência no Brasil”, editado pela Relume Dumará/FAPERJ. Foi bolsista da Fundação Alexander von Humboldt e selecionado em 2019 pela Comissão Fulbright para ocupar a UT-Fulbright Chair in Brazilian Studies (Austin). Foi Superintendente Acadêmico de Pós-Graduação da Pró-Reitoria de Pós-Graduação e Pesquisa da UFRJ (2015-2016).

(http://lattes.cnpq.br/7610075482763248)